لسو

لغت نامه دهخدا

فرهنگ فارسی

دانشنامه عمومی

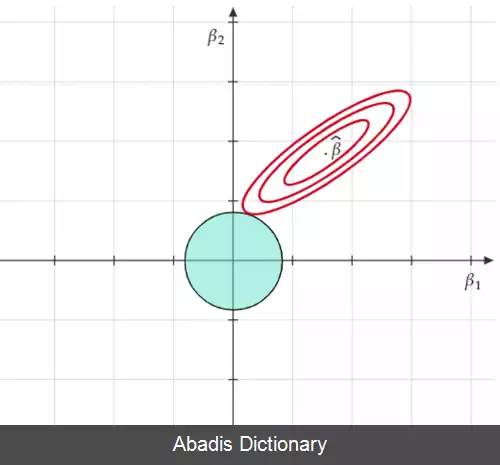

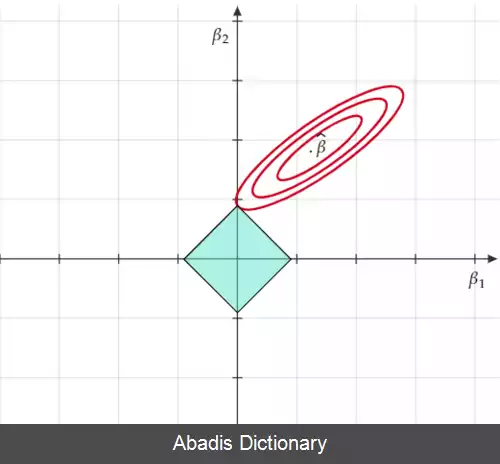

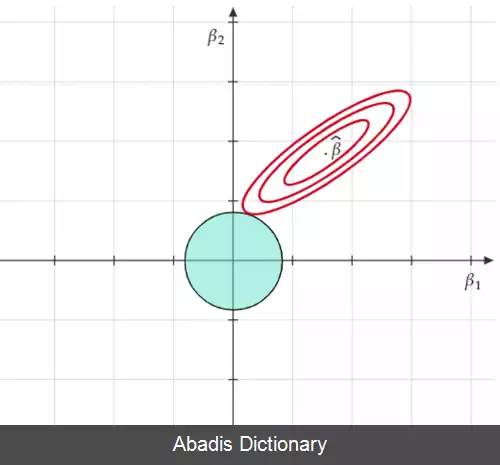

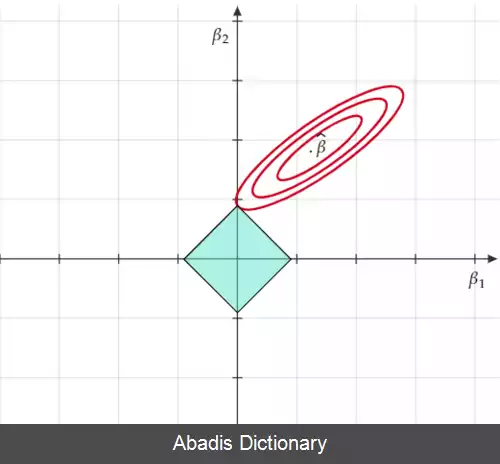

لَسو[ الف] یکی از روش های تنظیم مدل برای انتخاب ویژگی[ ب] و جلوگیری از بیش برازش در رگرسیون است که انتخاب متغیر و نرمال سازی را به منظور افزایش دقت پیش بینی و تفسیرپذیری مدل آماری حاصل انجام می دهد. این روش باعث می شود بسیاری از پارامترهای مدل نهائی صفر شده و مدل به اصطلاح خلوت[ پ] شود. [ ۱] در روش لَسو نُرمِ L 1 به تابع هزینه اضافه می شود. [ ۱]

با این وجود که لسو در ابتدا برای مدل های رگرسیون خطی تعریف شده بود، اما به سادگی به سایر مدل های آماری از جمله مدل های خطی تعمیم یافته، معادله برآورد تعمیم یافته، مدل های مخاطرات متناسب، و برآوردگرهای M قابل تعمیم است. [ ۲] [ ۳]

لسو به منظور بهبود دقت پیش بینی و تفسیرپذیری مدل های رگرسیون معرفی شد. در این روش، مجموعه کاهش یافته ای از متغیرها برای استفاده در یک مدل انتخاب می شوند. [ ۴] [ ۵]

لسو به طور مستقل در سال 1986 در زمینه ژئوفیزیک توسعه یافت و در سال 1996 توسط آماردان رابرت تیبشیرانی ترویج شد. این روش، دقت پیش بینی را بهبود بخشیده و با کاهش ضرایب خاصی از مدل به صفر، تأثیر آنها در پیش بینی نهایی را از میان می برد. با وجود شباهت میان این روش و رگرسیون خط الراس، عملکرد آنها متفاوت است. در رگرسیون خط الراس، اندازه مجموع توان های دوم ضرایب از مقدار ثابتی کوچک تر شده، اما خود ضرایب صفر نمی شوند ( انتخاب متغیر انجام نمی پذیرد ) .

اگر در مسئله رگرسیون، داده ها را به صورت D = { ( x 1 , y 1 ) , ⋯ , ( x N , y N ) } نمایش دهیم، هدف بدست آوردن y به عنوان ترکیبی خطی از x است یعنی x T β + β 0 . رگرسیون خطی معمولی به شکل پایین در پی یافتن β و β 0 بهینه است به طوری که خطای میانگین مربعات را کمینه کند:

min β 0 , β { 1 N ∑ i = 1 N ( y i − β 0 − x i T β ) 2 }

حال اگر داده ها را در ماتریس X و بردار Y بگنجانیم، مسئله به عبارت پایین تغییر شکل می دهد:

min β ∈ R p { 1 N ‖ Y − X β ‖ 2 2 }

دو دلیل کلی برای تغییر و بهبود روش خطای میانگین مربعات وجود دارد. مورد اول اینکه پیچیدگی مدل های پارامتری با تعداد پارامترهای مدل و مقادیر آن ها سنجیده می شود. هرچه این پیچیدگی بیشتر باشد خطر بیش برازش[ ت] برای مدل بیشتر است. [ ۶] پدیدهٔ بیش برازش زمانی رخ می دهد که مدل به جای یادگیری الگوهای موجود در داده، خود داده را به خاطر می سپارد. در این حالت، مدل برای آن مجموعه دادهٔ به خصوص خوب عمل می کند اما برای داده های مشابه دیگر عملکرد خوبی ندارد، که یعنی عمل یادگیری به خوبی انجام نشده است. در این حالت مدل، بایاس کم و واریانس زیادی دارد و در واقع بیش برازش اتفاق افتاده است. برای جلوگیری از بیش برازش در مدل های خطی مانند رگرسیون خطی یا رگرسیون لجستیک، یک «جریمه»[ ث] به تابع هزینه اضافه می شود تا از افزایش پارامترها جلوگیری شود. به این کار تنظیم مدل گفته می شود. [ ۷]

این نوشته برگرفته از سایت ویکی پدیا می باشد، اگر نادرست یا توهین آمیز است، لطفا گزارش دهید: گزارش تخلفبا این وجود که لسو در ابتدا برای مدل های رگرسیون خطی تعریف شده بود، اما به سادگی به سایر مدل های آماری از جمله مدل های خطی تعمیم یافته، معادله برآورد تعمیم یافته، مدل های مخاطرات متناسب، و برآوردگرهای M قابل تعمیم است. [ ۲] [ ۳]

لسو به منظور بهبود دقت پیش بینی و تفسیرپذیری مدل های رگرسیون معرفی شد. در این روش، مجموعه کاهش یافته ای از متغیرها برای استفاده در یک مدل انتخاب می شوند. [ ۴] [ ۵]

لسو به طور مستقل در سال 1986 در زمینه ژئوفیزیک توسعه یافت و در سال 1996 توسط آماردان رابرت تیبشیرانی ترویج شد. این روش، دقت پیش بینی را بهبود بخشیده و با کاهش ضرایب خاصی از مدل به صفر، تأثیر آنها در پیش بینی نهایی را از میان می برد. با وجود شباهت میان این روش و رگرسیون خط الراس، عملکرد آنها متفاوت است. در رگرسیون خط الراس، اندازه مجموع توان های دوم ضرایب از مقدار ثابتی کوچک تر شده، اما خود ضرایب صفر نمی شوند ( انتخاب متغیر انجام نمی پذیرد ) .

اگر در مسئله رگرسیون، داده ها را به صورت D = { ( x 1 , y 1 ) , ⋯ , ( x N , y N ) } نمایش دهیم، هدف بدست آوردن y به عنوان ترکیبی خطی از x است یعنی x T β + β 0 . رگرسیون خطی معمولی به شکل پایین در پی یافتن β و β 0 بهینه است به طوری که خطای میانگین مربعات را کمینه کند:

min β 0 , β { 1 N ∑ i = 1 N ( y i − β 0 − x i T β ) 2 }

حال اگر داده ها را در ماتریس X و بردار Y بگنجانیم، مسئله به عبارت پایین تغییر شکل می دهد:

min β ∈ R p { 1 N ‖ Y − X β ‖ 2 2 }

دو دلیل کلی برای تغییر و بهبود روش خطای میانگین مربعات وجود دارد. مورد اول اینکه پیچیدگی مدل های پارامتری با تعداد پارامترهای مدل و مقادیر آن ها سنجیده می شود. هرچه این پیچیدگی بیشتر باشد خطر بیش برازش[ ت] برای مدل بیشتر است. [ ۶] پدیدهٔ بیش برازش زمانی رخ می دهد که مدل به جای یادگیری الگوهای موجود در داده، خود داده را به خاطر می سپارد. در این حالت، مدل برای آن مجموعه دادهٔ به خصوص خوب عمل می کند اما برای داده های مشابه دیگر عملکرد خوبی ندارد، که یعنی عمل یادگیری به خوبی انجام نشده است. در این حالت مدل، بایاس کم و واریانس زیادی دارد و در واقع بیش برازش اتفاق افتاده است. برای جلوگیری از بیش برازش در مدل های خطی مانند رگرسیون خطی یا رگرسیون لجستیک، یک «جریمه»[ ث] به تابع هزینه اضافه می شود تا از افزایش پارامترها جلوگیری شود. به این کار تنظیم مدل گفته می شود. [ ۷]

wiki: لسو

پیشنهاد کاربران

پیشنهادی ثبت نشده است. شما اولین نفر باشید