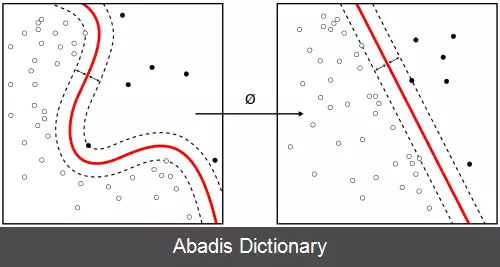

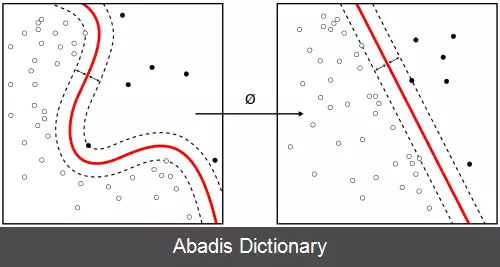

در یادگیری ماشینی، خودرمزگذار متغیر ( به انگلیسی: Variational autoencoder ) ، یک نوع شبکه عصبی مصنوعی است که متعلق به خانواده های روش های بیزی متغیر ( به انگلیسی: Variational Bayesian methods ) و مدل گرافیکی ( به انگلیسی: Graphical model ) است. [ ۱] خودرمزگذارهای متغیر علی رغم شباهت اسمی و ساختاری به خودرمزگذارها تفاوت های فراوانی در هدف و فرمول بندی ریاضی دارند. هر دو مدل از دو بخش رمزگذار و رمزگشا تشکیل شده اند، در هر دو مدل بخش رمزگذار سعی می کند داده ها را به یک فضای نهفته ( به انگلیسی: Latent space ) نگاشت کنند که داده ها در این فضا توسط متغیر پنهان توصیف می شوند. بخش رمزگشا سعی می کند داده ها را از فضای نهفته به فضای ورودی نگاشت کند از خودرمزگذار عادی برای کاهش ابعاد، کاهش نویز استفاده می شود. نحوهٔ عملکرد خودرمزگذار متغیر نیز همانند خودرمزگذار عادی است اما سعی می کنیم با استفاده از یک دانش پیشین ( به انگلیسی: A priori ) شروطی روی فضای نهفتهٔ تولید شده توسط رمزگذار قرار دهیم تا نقاط نزدیک ( به انگلیسی: Probability distribution ) هم در فضا داده هایی نزدیک به هم در فضای ورودی تولید کنند. در این روش رمزگذار می تواند چندین دادهٔ جدید از هر ورودی تولید کندک که همه از یک توزیع آماری نمونه برداری شده اند. [ ۲] [ ۳]

با اینکه این مدل در ابتدا برای یادگیری خودران ( خودسازمانده ) طراحی شده بود، [ ۴] [ ۵] به دلیل اثربخشی بالا عملکرد خود را در یادگیری نیمه نظارتی و یادگیری با نظارت اثبات کرده است. [ ۶] [ ۷] [ ۸]

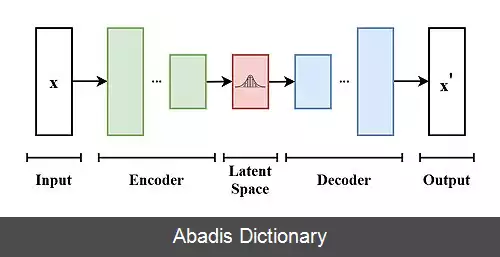

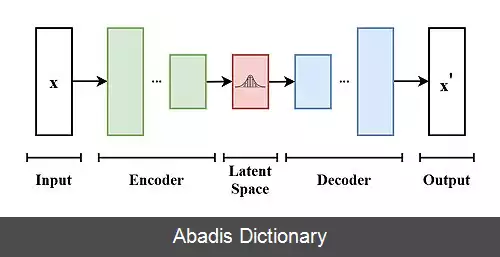

یک خودرمزگذار متغیر از دو شبکهٔ عصبی مصنوعی به نام های رمزگذار ( به انگلیسی: Encoder ) و رمزگشا ( به انگلیسی: Decoder ) طراحی شده است. شبکهٔ اول داده ها را به صورت خام می گیرد و پارامترهای توصیف کنندهٔ ورودی داده شده را به عنوان خروجی بخش اول تولید می کند. رمزگذار بخش دوم این مدل است که یک تابع است. وظیفه ی رمزگذار نگاشت داده ها از فضای نهان به فضای ورودی است; این کار با استفاده از تخمین پارامتر های میانگین و واریانس یک توزیع نویز ( به انگلیسی: Noise distribution ) و سپس نمونه گرفتن از آن انجام می شود.

برای بهینه سازی و آموزش این مدل نیاز به تعریف دو عبارت داریم: "خطای بازسازی" و واگرایی کولبک - لیبلر. تابع ضرر ( به انگلیسی: Loss function ) مشتق پذیر نهایی ما ترکیبی از این دو عبارت خواهد بود. واگرایی کولبک - لیبلر سعی در مشابه کردن توزیع پیشین فضای نهان که یک توزیع نرمال چند متغیره با میانگین صفر و ماتریس کوواریانس همانی فرض گرفته می شود با توزیع تخمینی ای که از بخش رمزنگار مدل ما بدست می آید دارد. عبارت خطای بازسازی وظیفه یکسان کردن خروجی مدل با ورودی داده شده را در بردارد.

این نوشته برگرفته از سایت ویکی پدیا می باشد، اگر نادرست یا توهین آمیز است، لطفا گزارش دهید: گزارش تخلفبا اینکه این مدل در ابتدا برای یادگیری خودران ( خودسازمانده ) طراحی شده بود، [ ۴] [ ۵] به دلیل اثربخشی بالا عملکرد خود را در یادگیری نیمه نظارتی و یادگیری با نظارت اثبات کرده است. [ ۶] [ ۷] [ ۸]

یک خودرمزگذار متغیر از دو شبکهٔ عصبی مصنوعی به نام های رمزگذار ( به انگلیسی: Encoder ) و رمزگشا ( به انگلیسی: Decoder ) طراحی شده است. شبکهٔ اول داده ها را به صورت خام می گیرد و پارامترهای توصیف کنندهٔ ورودی داده شده را به عنوان خروجی بخش اول تولید می کند. رمزگذار بخش دوم این مدل است که یک تابع است. وظیفه ی رمزگذار نگاشت داده ها از فضای نهان به فضای ورودی است; این کار با استفاده از تخمین پارامتر های میانگین و واریانس یک توزیع نویز ( به انگلیسی: Noise distribution ) و سپس نمونه گرفتن از آن انجام می شود.

برای بهینه سازی و آموزش این مدل نیاز به تعریف دو عبارت داریم: "خطای بازسازی" و واگرایی کولبک - لیبلر. تابع ضرر ( به انگلیسی: Loss function ) مشتق پذیر نهایی ما ترکیبی از این دو عبارت خواهد بود. واگرایی کولبک - لیبلر سعی در مشابه کردن توزیع پیشین فضای نهان که یک توزیع نرمال چند متغیره با میانگین صفر و ماتریس کوواریانس همانی فرض گرفته می شود با توزیع تخمینی ای که از بخش رمزنگار مدل ما بدست می آید دارد. عبارت خطای بازسازی وظیفه یکسان کردن خروجی مدل با ورودی داده شده را در بردارد.

wiki: خودرمزگذار متغیر