اتاق چینی ( به انگلیسی: Chinese Room ) یک آزمایش ذهنی است که اولین بار توسط مقاله جان سرل به نام «ذهن ها، مغزها، و برنامه ها» ( به انگلیسی: Minds, Brains, and Programs ) در مجله «علوم رفتاری و ذهنی» ( به انگلیسی: Behavioral and Brain Sciences ) در سال ۱۹۸۰ منتشر شد. وی با این سؤال که آیا یک برنامه هوشمند مترجم کامپیوتری که توانایی ترجمه از زبان چینی به زبان انگلیسی را دارد، ضرورتی برای فهم موضوع مورد ترجمه دارد یا خیر، و با تشبیه ذهن به یک برنامه هوشمند کامپیوتری این استدلال را در برابر مواضع فلسفی کارکردگرایی و نظریه محاسباتی ذهن که در آنها، ذهن به عنوان یک محاسبه گر یا دستکاری کنندهٔ نماد عمل می کند، قرار دهد. [ ۱] در واقع نتایج حاصل از آزمایش اتاق چینی حکایت از این دارد که هیچ برنامه ای نمی تواند به کامپیوتر ذهن، فهم یا آگاهی بدهد. حال آن برنامه هر آنچه می خواهد هوشمند باشد و باعث شود کامپیوتر همچون انسان رفتار کند. اگر چه این آزمایش در اصل جوابی برای اظهارات محققین هوش مصنوعی بود، اما این ادعا در برابر اهداف تحقیقات هوش مصنوعی قرار نمی گیرد چرا که این موضوع حدی برای هوشمندی کامپیوتر قائل نیست. همچنین این آزمایش مختص کامپیوترهای دیجیتال است و دامنه آن همه ماشین ها نیستند.

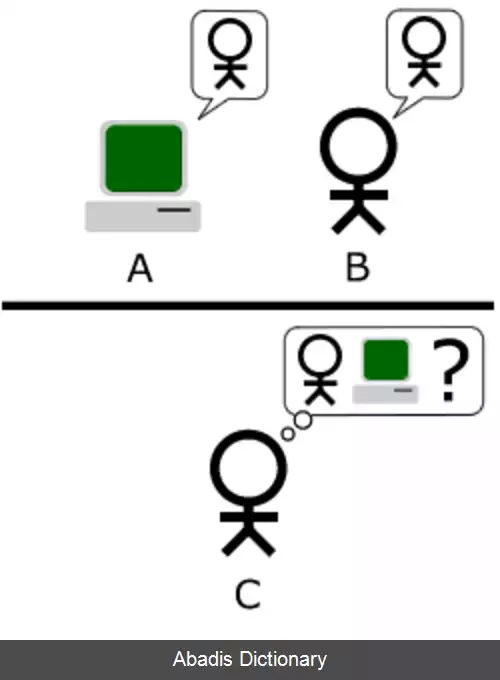

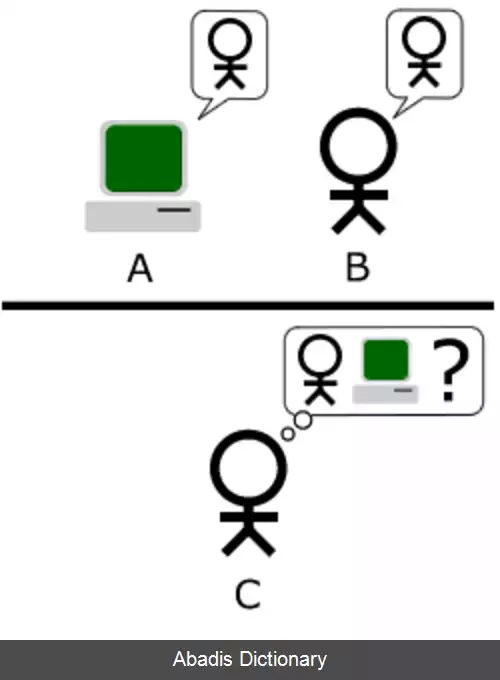

چیزی که اولین جرقه مقاله سرل به حساب می آمد این بود: فرض کنید تحقیقات هوش مصنوعی منجر به ساخت کامپیوتری شده است که می تواند زبان چینی را بفهمد. به این صورت که یک سری کاراکتر چینی به عنوان ورودی به آن داده می شود و با پردازشی که برنامه آن کامپیوتر انجام می دهد تعدادی کاراکتر دیگر چینی را خروجی می دهد. سرل می گوید فرض کنید این کامپیوتر به خوبی آزمون تورینگ را پشت سر می گذارد به این معنی که یک فرد چینی زبان متقاعد می شود که این ماشین خود یک فرد زنده چینی زبان است. حال سؤالی که مطرح می شود این است که آیا ماشین مذکور به معنی واقعی کلمه چینی می فهمد یا این فقط یک شبیه سازی از قابلیت چینی صحبت کردن است؟ سرل برای مورد اول از عبارت "هوش مصنوعی قوی" و برای مورد دوم از عبارت "هوش مصنوعی ضعیف" استفاده می کند. [ ۲]

سرل سپس ادامه می دهد: فرض کنید من درون یک اتاق در بسته محبوس شده باشم و یک کتاب به زبان انگلیسی دارم که در آن قواعد و مراحل اجرای یک برنامه کامپیوتری ( همان برنامه ای که ماشین به کمک آن قادر است ورودی چینی را به خروجی چینی تبدیل کند ) نوشته شده است. حال کسانی که بیرون اتاق هستند یک دسته بزرگ نوشته های چینی به من می دهند. فرض کنید ( همان طور که واقعاً این طور است ) من چیزی از زبان چینی نمی دانم نه نوشتن و نه خواندن و حتی من مطمئن نیستم که بتوانم بین نوشته های چینی یا زبان هایی شبیه آن مثلاً ژاپنی و شکلک های بی معنی تفاوت قائل شوم. از نظر من نوشته های چینی فقط پر از شکلکهای بی معنی است. با این حال من قادر هستم ورودی که از بیرون اتاق به زبان چینی دریافت کرده ام را به کمک کتاب و مراحل اجرای برنامه گفته شده پردازش کنم و یک یادداشت به زبان چینی را به افراد بیرون اتاق بدهم. او می گوید اگر کامپیوتر اینگونه تست تورینگ را پشت سر گذاشته است ( که در صورت پشت سر گذاشتن چنین است ) من هم می توانم چنین کاری کنم. حال او بیان می دارد در این آزمایش فرق جدی بین نقشی که کامپیوتر ایفا می کند با نقش او وجود ندارد چرا که هر دو یک سری گام هایی را برمی دارند و در نهایت برداشتی که از کار آن ها می شود این است که آن ها در یک گفتگو شرکت داشته اند. با این حال سرل قادر به فهم مکالمه نیست پس می توان اینگونه ادعا کرد که کامپیوتر نیز چنین است و مکالمه را نمی فهمد. سپس سرل اینگونه قضیه را بیان می کند که بدون "فهم" نمی توان عمل ماشین را "فکر کردن" توصیف کرد پس کامپیوتر نمی تواند فکر کند و در نتیجه نمی توان برای آن ذهن قائل بود. همه صحبت های بالا در نهایت سرل را به این نتیجه رهنمون کرد که فرضیه "هوش مصنوعی قوی" غلط است.

این نوشته برگرفته از سایت ویکی پدیا می باشد، اگر نادرست یا توهین آمیز است، لطفا گزارش دهید: گزارش تخلفچیزی که اولین جرقه مقاله سرل به حساب می آمد این بود: فرض کنید تحقیقات هوش مصنوعی منجر به ساخت کامپیوتری شده است که می تواند زبان چینی را بفهمد. به این صورت که یک سری کاراکتر چینی به عنوان ورودی به آن داده می شود و با پردازشی که برنامه آن کامپیوتر انجام می دهد تعدادی کاراکتر دیگر چینی را خروجی می دهد. سرل می گوید فرض کنید این کامپیوتر به خوبی آزمون تورینگ را پشت سر می گذارد به این معنی که یک فرد چینی زبان متقاعد می شود که این ماشین خود یک فرد زنده چینی زبان است. حال سؤالی که مطرح می شود این است که آیا ماشین مذکور به معنی واقعی کلمه چینی می فهمد یا این فقط یک شبیه سازی از قابلیت چینی صحبت کردن است؟ سرل برای مورد اول از عبارت "هوش مصنوعی قوی" و برای مورد دوم از عبارت "هوش مصنوعی ضعیف" استفاده می کند. [ ۲]

سرل سپس ادامه می دهد: فرض کنید من درون یک اتاق در بسته محبوس شده باشم و یک کتاب به زبان انگلیسی دارم که در آن قواعد و مراحل اجرای یک برنامه کامپیوتری ( همان برنامه ای که ماشین به کمک آن قادر است ورودی چینی را به خروجی چینی تبدیل کند ) نوشته شده است. حال کسانی که بیرون اتاق هستند یک دسته بزرگ نوشته های چینی به من می دهند. فرض کنید ( همان طور که واقعاً این طور است ) من چیزی از زبان چینی نمی دانم نه نوشتن و نه خواندن و حتی من مطمئن نیستم که بتوانم بین نوشته های چینی یا زبان هایی شبیه آن مثلاً ژاپنی و شکلک های بی معنی تفاوت قائل شوم. از نظر من نوشته های چینی فقط پر از شکلکهای بی معنی است. با این حال من قادر هستم ورودی که از بیرون اتاق به زبان چینی دریافت کرده ام را به کمک کتاب و مراحل اجرای برنامه گفته شده پردازش کنم و یک یادداشت به زبان چینی را به افراد بیرون اتاق بدهم. او می گوید اگر کامپیوتر اینگونه تست تورینگ را پشت سر گذاشته است ( که در صورت پشت سر گذاشتن چنین است ) من هم می توانم چنین کاری کنم. حال او بیان می دارد در این آزمایش فرق جدی بین نقشی که کامپیوتر ایفا می کند با نقش او وجود ندارد چرا که هر دو یک سری گام هایی را برمی دارند و در نهایت برداشتی که از کار آن ها می شود این است که آن ها در یک گفتگو شرکت داشته اند. با این حال سرل قادر به فهم مکالمه نیست پس می توان اینگونه ادعا کرد که کامپیوتر نیز چنین است و مکالمه را نمی فهمد. سپس سرل اینگونه قضیه را بیان می کند که بدون "فهم" نمی توان عمل ماشین را "فکر کردن" توصیف کرد پس کامپیوتر نمی تواند فکر کند و در نتیجه نمی توان برای آن ذهن قائل بود. همه صحبت های بالا در نهایت سرل را به این نتیجه رهنمون کرد که فرضیه "هوش مصنوعی قوی" غلط است.

wiki: اتاق چینی